AI Deepfake: தமன்னாவுக்குப் பதில் சிம்ரன்; வைரலாகும் நடன வீடியோ ஐடியாவில் இத்தனை ஆபத்துகளா?

கடந்த ஜூன் 10ம் தேதி `ஜெயிலர்' படத்தின் `காவாலா' பாடல் வெளியாகி ரசிகர்களிடையே பெரும் வரவேற்பைப் பெற்றது. அதே பாடலுக்கு நடனமாடும் விதமாக தமன்னா ஒரு வீடியோவை வெளியிட்டிருந்தார். தற்போது பலரும் அந்த வீடியோ பாணியிலேயே நடனமாடி சமூக ஊடகங்களில் பதிவிட்டு வருகின்றனர்.

இந்நிலையில் இந்த வீடியோவில் தமன்னாவிற்குப் பதில் நடிகை சிம்ரன் நடனமாடுவது போன்ற, AI மூலம் உருவாக்கப்பட்ட இன்னொரு வெர்ஷன் இணையத்தில் வைரலாகி வருகிறது. இந்த வீடியோவை தமன்னாவும் தன் ட்வீட்டர் பக்கத்தில் பதிவிட்டு, சிம்ரனையும் டேக் செய்திருந்தார். இதெல்லாம் தெரிந்த விஷயம்தானே. இதில் என்ன அச்சுறுத்தல் இருக்கிறது, நான்கூட அதை ஷேர் செய்தேன், ஹார்ட் ரியாக்ட் செய்தேன் என்கிறீர்களா? அதில்தான் சிக்கலே!

ஒருவரின் முகத்தை ஒரு வீடியோவில் வரும் மற்றொரு நபரின் முகத்தோடு பொருத்தும் தொழில்நுட்பம்தான் 'Deepfake'. அதில் தற்போது வளர்ந்துவரும் AI தொழில்நுட்பத்தையும் இணைத்துத்தான் தத்ரூபமாக மேலே குறிப்பிட்ட சிம்ரன் வெர்ஷன் வீடியோ உருவாக்கப்பட்டுள்ளது.

AI Deepfake என்றால் என்ன?

கடந்த பத்து வருடங்களில் செயற்கை நுண்ணறிவு கால் பதிக்காத துறைகளே இல்லை. AI-ன் வளர்ச்சியின் அடுத்தகட்ட பரிமாணம் தான் இந்த AI Deepfake. இது AI-ன் 'Deep Learning' என்ற கோட்பாட்டை மையமாகக் கொண்டு உருவானது. ஏற்கனவே கொட்டிக்கிடக்கும் தரவுகளை கொண்டு ஒவ்வொன்றையும் எப்படி செய்யவேண்டும் என கற்றுக்கொள்ளும் AI. எந்த அளவு அதிகமான தரவுகள் இருக்கிறதோ, அந்த அளவு மேம்படும் AI. இந்த 'Deep Learning' முறை பல ஆண்டுகளுக்கு முன்பே கோட்பாட்டளவில் வந்துவிட்டாலும், இன்று கொட்டிக்கிடக்கும் தரவுகளும், பல மடங்கு மேம்பட்ட கணினித் திறனும் இன்று அது முழுவதுமாக உயிர்பிக்கப்பட்டிருக்கிறது.

ஒருவர் பேசாத ஒன்றை பேசியதாக, நடக்காத ஒன்றை நடந்ததாக இந்த AI Deepfake தத்ரூபமாக உருவாக்கமுடியும்.

AI Deepfake-ன் பரிமாணம்...

NVIDIA என்னும் அமெரிக்க நிறுவனத்தில் பணிபுரிந்த ஃபிலிப் வாங் எனும் மென்பொருள் வடிவமைப்பாளர்தான் AI Deepfake இணையதளங்களை முதலில் உருவாக்கினார். பின்னர், NVIDIA நிறுவனம் அதை GAN (A Generative Adversarial Network) என்ற அல்காரிதம் மூலம் செயல்படக் கூடிய ஒரு நிரலாக (program) மாற்றியமைத்தது. முன்பு சொன்னது போல, AI Deepfake மென்பொருள்கள் தரவுகளைப் பகுப்பாய்வு செய்து, தானே கற்றுக்கொண்டு அதற்கேற்ப செயல்படுகின்றன. சமீபத்தில் கூட ஓடிசாவில் அறிமுகப்படுத்தப்பட்ட லிசா எனும் AI செய்தி வாசிப்பாளர் பற்றி நாம் கேள்விப்பட்டிருப்போம். இவ்வாறு பொழுதுபோக்கு, கல்வி, தகவல்தொடர்பு சார்ந்த வீடியோக்களை உருவாக்க இப்போதே AI தொழில்நுட்பத்தை பயன்படுத்த தொடங்கிவிட்டனர்.

இந்தத் தொழில்நுட்பத்தைப் பயன்படுத்தி ஒருவரின் முகத்தை எப்படி வேண்டுமானாலும் மாற்றி அமைக்கலாம். வேறொரு நபராகக் கூட மாற்றிவிடலாம். ஒரு வீடியோவில் இருக்கக்கூடிய இன்னொருவரின் முகத்தோடும் பொருத்தலாம். மேலும், அந்த வீடியோவில் இருப்பவரின் உதட்டு அசைவில் சிறு பிசகோ செயற்கைத்தன்மையோ கூட இல்லாமல் அவர் தனது சொந்த குரலில் பேசுவது போலவே மாற்றி அமைக்கலாம்.

AI Deepfake எவ்வாறு செயல்படுகிறது..?

இதில் உள்ள GAN அல்காரிதம் இரண்டு பாகங்களாக வேலை செய்கிறது. ஒரு பாகம் ஏராளமான தரவுகளைப் பகுப்பாய்வு செய்து போலி முகங்களை உருவாக்குகிறது. இரண்டாவது பாகம் இவ்வாறு போலியாக உருவாக்கப்பட்ட முகங்களை அவற்றின் அசல் தோற்றத்தோடு ஒப்பிட்டுப் பார்க்கிறது. அவற்றில் ஏதேனும் குறைபாடுகள் இருந்தால், அல்காரிதம் தானாகவே அதை நுண் திருத்தம் செய்து மீண்டும் புதிய முகங்களை உருவாக்கும். இவ்வாறு அசலும் போலியும் 100% பொருந்தும் வரை தொடர்ந்து புதிய போலி முகங்களை உருவாக்கிக் கொண்டும் அதன் பிழைகளைத் திருத்திக் கொண்டும் வரும். காலப்போக்கில் எது பார்க்க அசல் போல இருக்கிறது, எது இல்லை என நாம் தரப்போகும் தரவுகளை வைத்தே AI Deepfake தாமாகவே கற்றுக்கொண்டு இன்னும் அசலான, பிசிறில்லாத போலியான முகங்களை ஒரு சில நொடிகளில் உருவாக்கத் தயாராகிவிடும்.

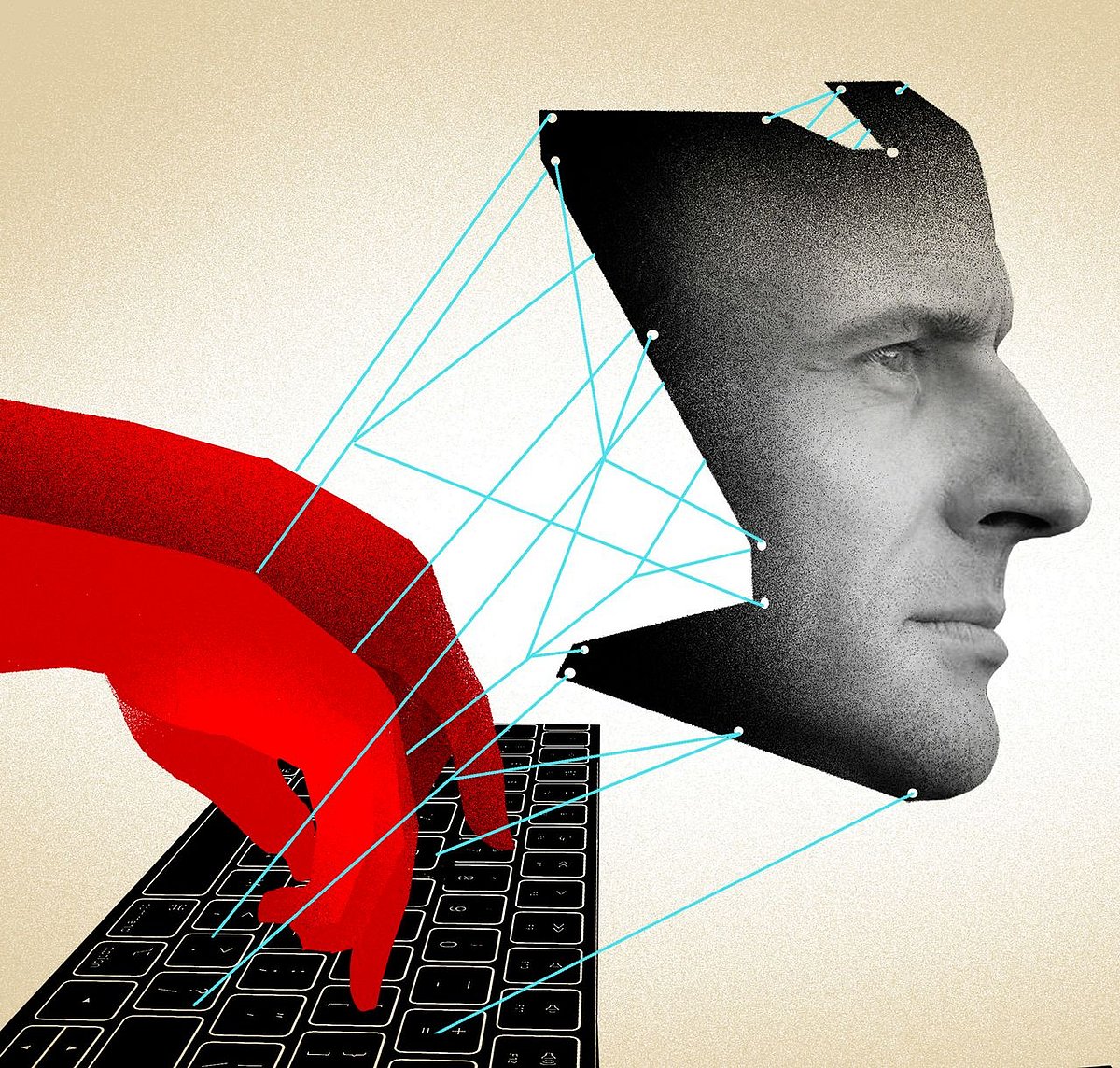

AI Deepfake தொழில்நுட்பம் வருவதற்கு முன், இது போன்ற வீடியோக்கள் அல்லது படங்கள் போட்டோஷாப் என்ற போட்டோ எடிட்டிங் மென்பொருள்கள் மூலம் உருவாக்கப்பட்டன. ஆனால், இதற்கு அதிக நேரமும், நல்ல பயிற்சியும் வேண்டியிருந்தது. தற்போது, AI Deepfake-ஐ பயன்படுத்தி ஒரு சில நொடிகளில் சாமானியர்களால் கூட இத்தகைய போலியான வீடியோக்களை உருவாக்க முடியும்.

கல்வி நிறுவனங்கள் AI Deepfake தொழில்நுட்பத்தைக் குழந்தைகளின் கற்றல் திறனை மேம்படுத்தப் பயன்படுத்துகிறார்கள். திரைப்படத்துறைகளில் நடிகர்களின் முகத்தை வயதானவர்களைப் போலச் சித்திரிப்பதற்கும், இளமையானவர்களாகக் காட்டுவதற்கும் (Digital De-aging) AI Deepfake தொழில்நுட்பம் அதிக அளவில் பயன்படுகின்றன. ஹாலிவுட்டடிற்காக இதைசெய்ய மெட்டா பிசிக் (Metaphysic) போன்ற பெயர்பெற்ற நிறுவனங்களும் உண்டு. AI Deepfake மென்பொருளில் கைதேர்ந்த இளைஞர்கள் இதன் மூலம் செம கலாட்டாவான வீடியோக்கள் மற்றும் மீம்ஸ்களை உருவாக்கி வருகின்றனர். இதற்குத் தனது நண்பர்களின் புகைப்படத்தையோ அல்லது பிரபலங்களின் படங்களையோ பயன்படுத்துகிறார்கள்.

AI Deepfake-ன் அச்சுறுத்தல்கள்:

AI Deepfake பலவிதங்களில் சமாளிக்க முடியாத அச்சுறுத்தலை ஏற்படுத்தலாம். இதன் மூலம் உருவாக்கப்பட்ட வீடியோக்கள், படங்கள் பிறரைப் புண்படுத்தும் விதமாக அவதூறான தகவல்களைப் பரப்ப வாய்ப்புள்ளது. மேலும், சமூக வலைதளங்கள் வழியாக அடையாளத் திருட்டும் நடைபெற வாய்ப்புள்ளது. அதன் வழியாகச் சர்ச்சைக்குரிய பொய்யான செய்திகளும் மக்களிடையே பரவலாம்.

நீதித்துறையிலும் இதன் தாக்கம் எதிரொலிப்பதற்கு வாய்ப்புகள் உள்ளன. வீடியோ, ஒரு ஆதாரமாகவே எடுத்துக் கொள்ளப்படாத நிலை கூட வரலாம். இந்நிலையில் குற்றவாளிகள் தண்டனையிலிருந்து தப்பலாம். நிரபராதிகள் தண்டிக்கப்படலாம். AI Deepfake மூலம் சைபர் குற்றங்கள் அதிகரிக்கலாம். குறிப்பாக, பெண்களை அல்லது திரைப்பட பிரபலங்களை ஆபாசமாகச் சித்திரித்து பாலியல் தொல்லைகள் கொடுப்பதற்கான சாத்தியக்கூறுகளும் உள்ளன. மேலும், சில சமூக விரோதிகள் மற்றும் பயங்கரவாதிகள் மக்களிடையே தவறான தகவல்களைப் பரப்பி அதன் மூலம் வன்முறையை ஏற்படுத்தவும் வாய்ப்புகள் உண்டு.

இந்த அச்சுறுத்தல்களை எவ்வாறு எதிர்கொள்வது?

பல முன்னணி நாடுகளில் AI Deepfake தொழில்நுட்பத்தைப் பயன்படுத்துவதற்குப் பல கட்டுப்பாடுகள் விதிக்கப்பட்டுள்ளன. அமெரிக்காவின் கலிபோர்னியா மாகாணத்தில் தேர்தல் நடப்பதற்கு 60 நாள்களுக்கு முன்பு AI Deepfake மூலம் உருவாக்கப்பட்ட அரசியல் சார்ந்த வீடியோக்களை வெளியிடுவதற்குத் தடை விதிக்கப்பட்டுள்ளது. சீனாவில் மக்களுக்கும், சமூகத்திற்கும் தீங்கு விளைவிக்கும் வகையில் தகவல்களைப் பரப்பும் AI Deepfake-க்கும், தனிமனித உரிமையை மீறிச் செயல்படும் AI Deepfake-க்கும் தடை விதிக்கப்பட்டிருக்கிறது. மேலும், கடந்த 2010ல் மெட்டா நிறுவனமும் அதன் சமூக வலைதளங்களில் தவறாகக் கையாளப்பட்ட வீடியோக்களுக்கு அனுமதி இல்லை என்று அறிவித்தது.

இந்தியாவில் இந்தத் தொழில்நுட்பத்தைக் கட்டுப்படுத்துவதற்கு என்று எந்தவொரு தெளிவான சட்டங்களும் இதுவரை இல்லை என்பதே நிதர்சனம். மேலும், வாட்ஸ்அப்பில் அனுப்பும் ஒற்றை குறுஞ்செய்தியால் கலவரம் ஏற்படும் நிலையில்தான் நாம் இன்னுமே இருக்கின்றோம். எனவே இதுபோன்ற பெரிய அச்சுறுத்தல்களைத் தடுப்பதற்கு அதன் ஆரம்ப நிலையிலேயே ஒரு தீர்வு காணப்பட வேண்டும்.

வழக்கமாக, மென்பொருளில் உள்ள வைரஸைக் கண்காணித்து நீங்குவதற்கு ஆன்டி வைரஸ்களைப் பயன்படுத்துகின்றோம். அதுபோல, இதுபோன்ற போலியான படங்களையோ வீடியோக்களையோ கண்காணிப்பதற்கான மென்பொருளை சில நிறுவனங்கள் உருவாக்க முயற்சி செய்து வருகின்றன, அதில் சில ஓரளவு வெற்றியும் பெற்றிருக்கின்றன. ஏனெனில், வருகின்ற எதிர்காலத்தில் AI Deepfake மிகப் பெரிய மாற்றங்களையும் சர்ச்சைகளையும் உருவாக்கும் என்பதில் சந்தேகமில்லை.

- மணிமேகலை பெரியசாமி

from விகடன்

No comments